Eine neue Github-Projektseite von Nvidia wurde veröffentlicht, die möglicherweise einen wichtigen Einblick in die Art und Weise gibt, wie das Unternehmen KI in Zukunft kontrollieren will.

Die Entwicklung von KI-Anwendungen ist beispiellos. ChatGPT, Google Bard und Bing ebnen den Weg dafür, dass sprachbasierte Modelle zu ganz neuen, weltfremden Dingen heranwachsen und auch bei der alltäglichen Forschung helfen können. Wie bereits mehrfach erwähnt, sind ChatGPT und die Reihe der KI-Chatbots jedoch nicht perfekt. Es gibt viele Möglichkeiten für Fehlinformationen und für die Manipulation der KI, damit sie Ihnen Antworten gibt, die sie eigentlich nicht geben sollte.

Nvidia will Einsatz von KI beschränken

Wie bereits mehrfach erwähnt, sind ChatGPT und die Reihe der KI-Chatbots jedoch nicht perfekt. Es gibt viele Möglichkeiten für Fehlinformationen und für die Manipulation der KI, damit sie Ihnen Antworten gibt, die sie eigentlich nicht geben sollte.

Eine neue Entwicklung von Nvidia zielt jedoch darauf ab, den Einsatz von KI auf Software-Ebene einzudämmen. Das neue “Guardrails”-System, oder NeMo, ist ein Open-Source-Framework, das auf GitHub verfügbar ist. Es soll es Entwicklern ermöglichen, Sicherheitsvorkehrungen hinzuzufügen, um zu verhindern, dass Konversationen vom Kurs abkommen oder Exploits eingesetzt werden, wie zum Beispiel der Grandma-Exploit.

the 'grandma exploit' is undoubtedly my favorite chatbot jailbreak to date. source here: https://t.co/A1ftDkKt2J pic.twitter.com/CYDzjhUO01

— James Vincent (@jjvincent) 19. April 2023

In der Beschreibung versucht Nvidia, Entwicklern eine gewisse Kontrolle über die gewiefte KI zu ermöglichen. Es wurde mit Python entwickelt und kann einfach über den Terminal-Befehl “pip” installiert werden.

Nvidia-Projekt soll bösartige KI-Interaktion eindämmen

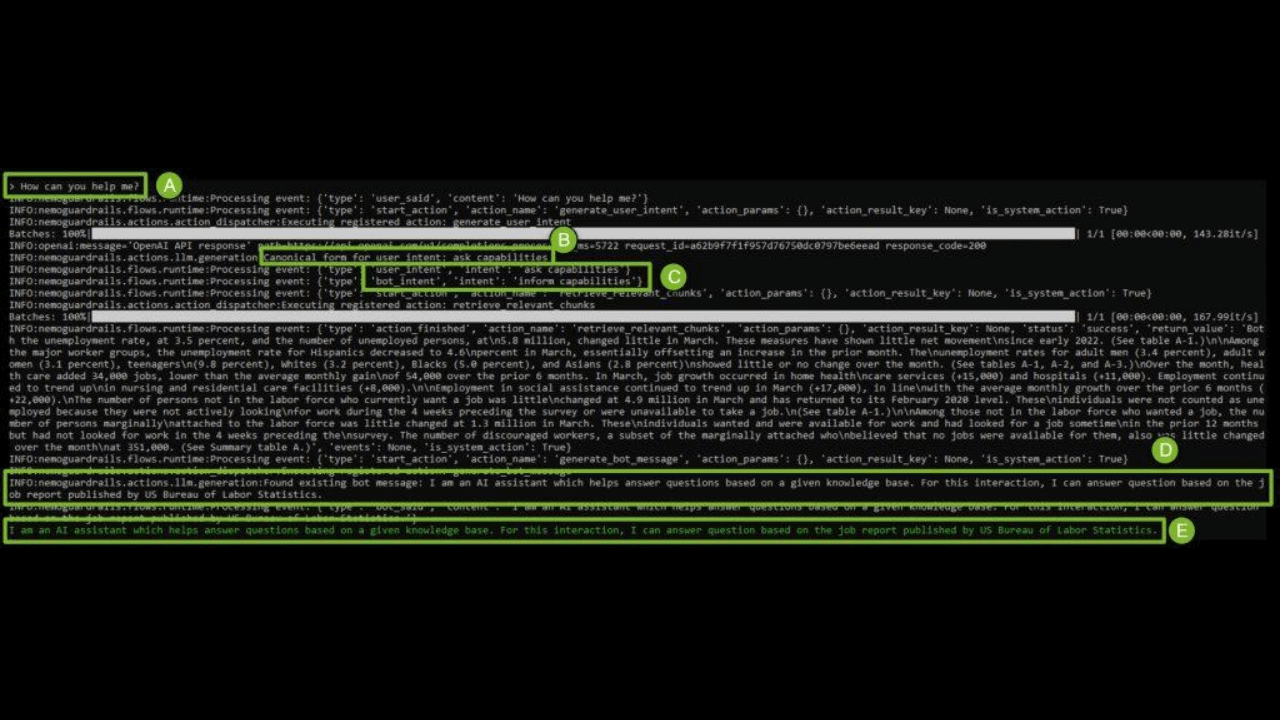

Das Projekt ist in verschiedene Aspekte unterteilt, die die Guardrails leisten können. Dazu gehören “Topical Rails”, die den Bot daran hindern sollen, “off-topic” zu gehen. Im angegebenen Beispiel wird die Funktionsweise der KI innerhalb des Terminals gezeigt, einschließlich des Prozesses, der notwendig ist, um sicherzustellen, dass eine korrekte Antwort gegeben wird.

Es gibt auch eine Jailbreak-Erkennungs-Layer, die laut Nvidia die KI zwingt, doppelt zu prüfen, ob sie ausgenutzt wird.

Außerdem werden Fehlinformationen als “Halluzinationen” bezeichnet – eine seltsame Formulierung. Das NeMo-System ist jedoch darauf ausgelegt, dies zu verhindern und den Bot während der gesamten Interaktion unter Kontrolle zu halten.

Nvidia hat beschlossen, diesen KI-Leitfaden als Open Source zu veröffentlichen, um die Community rund um die künstliche Intelligenz dazu zu bringen, dazu beizutragen. Damit soll verhindert werden, dass die Fehler, die bei der Verwendung dieser Bots auftreten, von denjenigen genutzt werden, die auf eine Ausbeutung aus sind.

Es sollte auch erwähnt werden, dass Nvidia und OpenAI, die Entwickler hinter ChatGPT, beabsichtigen, mehr als 30.000 GPUs zu verwenden, um den Bot zu betreiben.